En medio del despliegue militar de Estados Unidos en Medio Oriente, con motivo del asedio a Irán para desbaratar el programa nuclear persa y desfinanciar al terrorismo chiita, el presidente Donald Trump incluyó en una lista negra a Anthropic, después de que esta startup de inteligencia artificial se negara a otorgarle acceso al Pentágono sin restricciones a su sistema de IA para fines militares. Sin embargo, la empresa sacó un as de la manga y calificó la acción como "legalmente infundada".

PARA FINES MILITARES

Pulseada entre Donald Trump / USA y Anthropic por uso de IA para la guerra

Donald Trump prohibió a Anthropic, la startup de inteligencia artificial, tras el fracaso de las negociaciones sobre el uso militar de sus modelos de IA Claude, pero la empresa contratacó calificando la acción como "legalmente infundada".

El viernes por la tarde, Trump ordenó a todas las agencias federales que cesaran de inmediato el uso de la tecnología de Anthropic, prohibiendo a sus empleados utilizar esta IA, y al mismo tiempo le pidió al secretario de Defensa, Pete Hegseth, que designara a la compañía como un "riesgo para la cadena de suministro y la seguridad nacional", luego de que la empresa denegara al Departamento de Defensa el acceso a la herramienta Claude IA para uso militar y de control ciudadano.

Según fuentes familiarizadas con el asunto, las negociaciones entre Anthropic y funcionarios del Departamento de Defensa llevaban meses en curso sobre posibles usos militares para los modelos de lenguaje de gran tamaño de la compañía, pero la start up le exigió que aceptaría un acuerdo si le garantizaban que su IA no iba a ser utilizada para espionaje masivo interno ni para armas autónomas.

Dichas conversaciones llegaron a un punto muerto, y el Pentágono respondió designando a Anthropic como un riesgo para la cadena de suministro, una etiqueta que la Casa Blanca suele usar para empresas extranjeras con prácticas cuestionables o que representen un peligro para la seguridad nacional.

La batalla entre el Gobierno de Trump y Anthropic a la que entró OpenAI

Anthropic, la startup de inteligencia artificial conocida por crear Claude con un enfoque en la seguridad y los principios constitucionales, cuestionó este jueves la designación por parte del Pentágono como un riesgo para la cadena de suministro, calificando cualquier intento de incluirla en la lista negra como "legalmente infundado".

La compañía sostiene que sus principios de seguridad de IA y su negativa a comprometerse con un acceso militar sin restricciones no deberían activar los mismos mecanismos de seguridad nacional que se emplean contra actores hostiles.

Mientras tanto, su CEO hizo mención a su competencia, OpenAI, que firmó acuerdos con el Departamento de Defensa, permitiendo al Gobierno usar la IA para "todos los propósitos legales", la misma cláusula que Anthropic rechazó por considerar insuficientes las salvaguardas.

“La razón principal por la que (OpenAI) aceptó (el acuerdo del Departamento de Defensa) y nosotros no es que a ellos les importaba apaciguar a los empleados, y a nosotros nos importaba prevenir abusos”, disparó el cofundador y director ejecutivo de Anthropic, Dario Amodei, quien además escribió la relación del Pentágono con OpenAI como "teatro de seguridad".

Lo controversial es que en la letra chica, OpenAI cita la Orden Ejecutiva 12333: el mismo mecanismo legal que usó la Agencia de Seguridad Nacional (NSA) para espiar comunicaciones de estadounidenses interceptándolas fuera del país, según filtró el ex trabajador de sistemas de la CIA y la NSA, Edward Snowden, actualmente asilado en Moscú, que habló del sistema PRISM.

En ese sentido, estos modelos de IA a los que OpenIA les dio acceso al Departamento de Defensa estadounidense podrían utilizarse para análisis de información, traducción, generación de informes, logística o simulaciones, incluso para control social y en contextos militares, procesando lenguaje, comprendiendo situaciones y generando recomendaciones que podrían integrarse en sistemas de decisión militar, drones o armas autónomas, lo que, según muchos especialistas, supone riesgos éticos y legales.

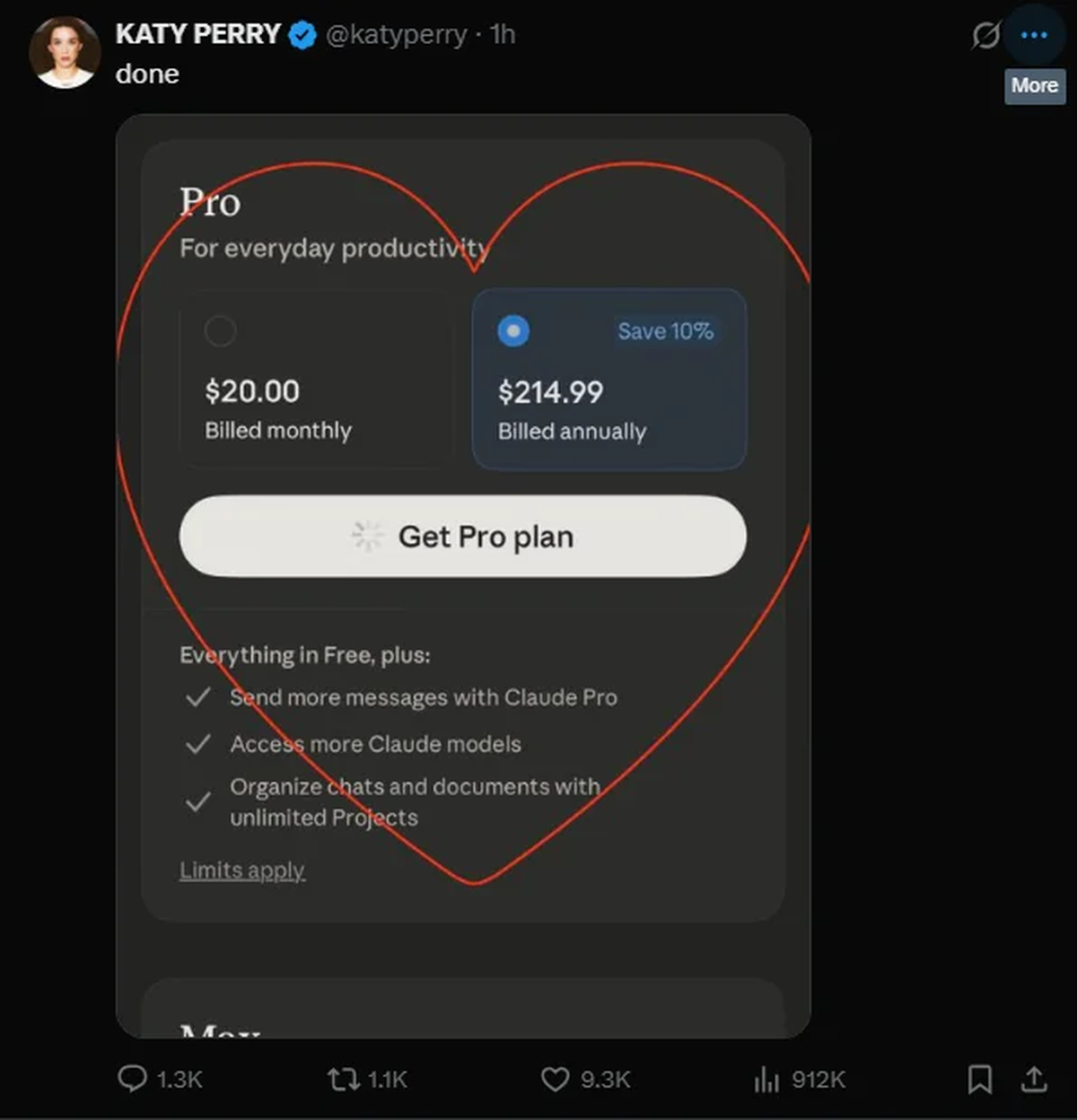

Ante ello, Claude, la IA de Anthropic, se convirtió en las últimas horas en la aplicación gratuita más descargada en EE.UU., mientras que, debido al polémico acuerdo entre el Departamento de Defensa y OpenAI, se reportó una desinstalación masiva de ChatGPT, un movimiento impulsado por la tendencia en redes sociales “#CancelChatGPT”, a la que se unieron personalidades del espectáculo, incluida la cantante Katy Perry.

Más contenido en Urgente24

Revolución en Boca Juniors por lo que comentan sobre Exequiel Zeballos

Tensión total en TN por un comentario que se escuchó al aire: "Los docentes ven una pala y..."

A bayoneta calada contra el diputado cosplayer Luis Petri

Masacre laboral en supermercados y el efecto que perjudica a ChangoMás

Coudet aceleró y le saca una figura a San Lorenzo para sumarlo a River