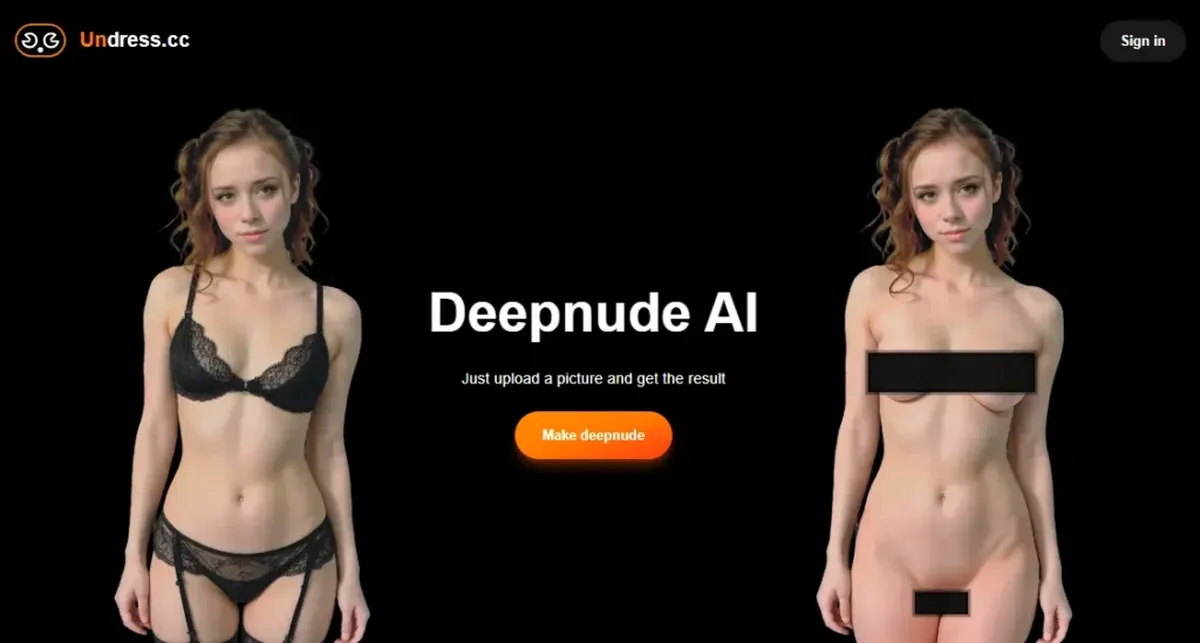

El mundo de la inteligencia artificial dio un salto gigantesco en términos de deepfake- esos videos falsos que parecen reales. Los investigadores de ByteDance, la compañía propietaria de TikTok, presentaron una tecnología que dejó a todos con la boca abierta: OmniHuman-1, un sistema capaz de generar videos deepfake tan realistas que resulta casi imposible distinguirlos de los auténticos.

TERROR DIGITAL

Inteligencia Artificial: Crean deepfakes perfectos que podrían destruir tu vida con solo una foto

La empresa dueña de TikTok desarrolló un generador de videos falsos ultrarrealistas usando apenas una imagen y un audio. La inteligencia artificial da miedo.

Quizás te interese leer: Elon Musk dio un inquietante vaticinio sobre la Inteligencia Artificial

¿Pero cómo funciona esta inteligencia artificial?

Lo más impactante de OmniHuman-1 es su simplicidad: solo necesitás una imagen de referencia y un audio para crear un video de cualquier duración. El sistema permite ajustar la proporción del cuerpo mostrado y la relación de aspecto del video. Para lograr este nivel de realismo, los desarrolladores entrenaron al modelo con 19.000 horas de contenido videográfico.

La tecnología ya mostró su cara más oscura en recientes eventos políticos. En Taiwán, grupos vinculados al Partido Comunista Chino usaron audio falso para manipular las elecciones. En Moldavia, circularon videos deepfake de la presidenta Maia Sandu renunciando. Según la consultora Deloitte, el contenido generado por IA provocó pérdidas por fraude superiores a los 12.000 millones de dólares en 2023, y podría alcanzar los 40.000 millones en Estados Unidos para 2027.

La preocupación es tal que varios estados norteamericanos implementaron leyes contra la suplantación de identidad mediante IA. Una encuesta de Jumio reveló que el 60% de las personas encontró un deepfake en el último año, y el 72% teme ser engañado por este tipo de contenido diariamente. Mientras tanto, las redes sociales y los buscadores luchan contra una marea creciente de contenido manipulado que parece no tener fin.

La trampa legal sin salida de las deepfakes en la era de la inteligencia artificial

Los marcos jurídicos actuales revelan una preocupante desprotección. En Estados Unidos, no existe ningún requisito federal que obligue a eliminar estas imágenes, mientras los gobiernos mundiales debaten sin consensuar estrategias efectivas.

El caso de Omny Miranda Martone gráfica la pesadilla: tras años trabajando contra la violencia sexual digital, terminó convertido en víctima de deepfakes que circulaban libremente en redes sociales. Su experiencia demuestra que ni siquiera los expertos pueden defenderse completamente.

Las consecuencias trascienden lo individual. En Australia, un adolescente manipuló digitalmente imágenes de 50 compañeras estudiantes, desnudando la vulnerabilidad, especialmente de mujeres y menores ante esta tecnología invasiva.

Taylor Swift es una de las artistas más famosas y exitosas del mundo, pero también una de las más acosadas y vulneradas. Se descubrió que usuarios en redes sociales (X/Twitter) usaron su imagen para crear deepfakes y contenido erótico con inteligencia artificial. Y la decisión de varías redes fue severa.

Según informó The Wallstreet Journal, la red social X, creada por el empresario Elon Musk como una alternativa a Twitter, bloqueó las búsquedas sobre Taylor Swift días después de que este contenido comenzara a proliferar en su plataforma. X tiene políticas que prohíben expresamente este tipo de medios sintéticos y manipulados y la desnudez no consensuada.

-------------------------------------------------------------------

Más contenido en Urgente24

La novedad de Banco Nación que todos quieren aprovechar

La miniserie de 6 capítulos que todos ven en un día y piden segunda parte

Cuánto dinero podés retirar de los cajeros automáticos a partir de febrero del 2025

Impuesto sobre las transferencias: De cuánto es y cómo evitarlo

¿Moda o porno?: La esposa de Kanye West apareció desnuda en los Grammys