TSUNAMI GEOPOLÍTICO

Tragedia Americana: China igualó a USA en IA con 2 mangos, Nvidia pierde US$ 620.000M

Bienvenido Donald Trump al mundo real. America First tiene límites. China 'empardó' pese a las muchas sanciones de USA y su DeepSeek pegó en Nvidia.

Stephen Yiu, director de inversiones de Blue Whale Growth, fondo de inversión respaldado por el multimillonario Peter Hargreaves, dijo que el avance de DeepSeek es un "avance muy positivo para la adopción, el desarrollo y la penetración de la IA".

Las mayores empresas tecnológicas estadounidenses “han tenido acceso monopólico a la IA: el precio de entrada era de miles de millones de dólares, de lo contrario no había posibilidad de desafiar el statu quo”, dijo Yiu. “DeepSeek ha nivelado el campo de juego”.

En diciembre 2024, Blue Whale Growth redujo su riesgo en las "7 Magníficas" empresas tecnológicas estadounidenses más importantes porque sospechó del volumen de gasto en inteligencia artificial.

Derrumbe

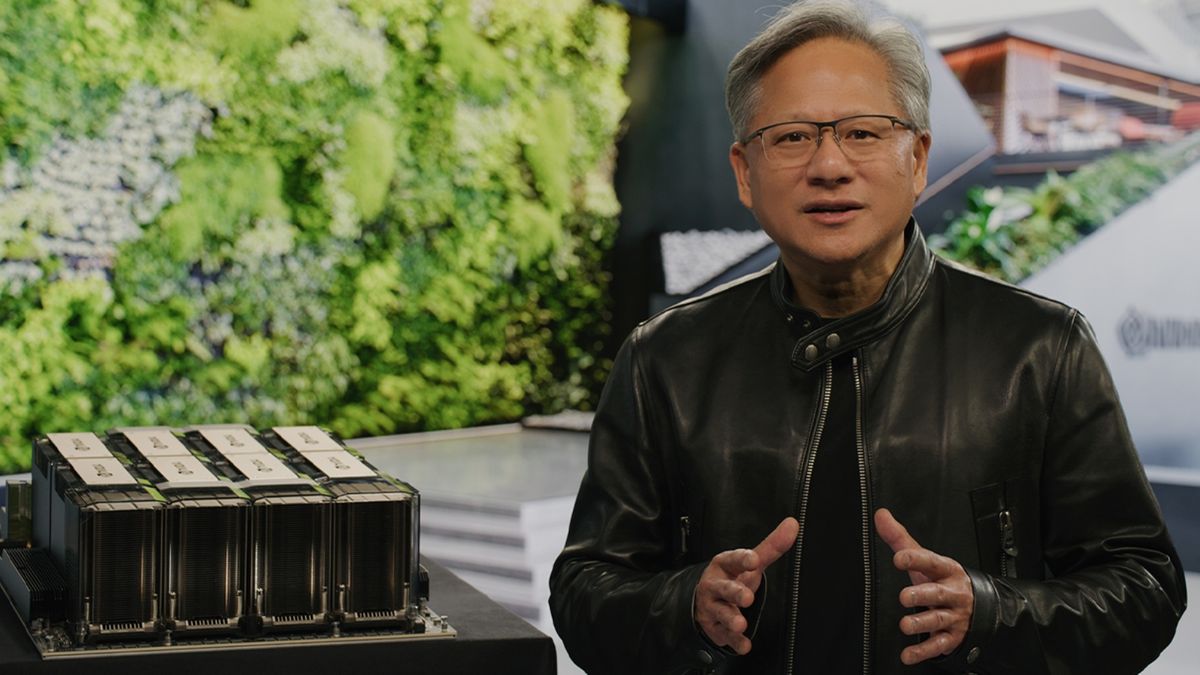

El lunes 27/01, Nvidia sufrió una pérdida de capitalización de mercado de US$ 620.000 millones, su mayor caída diaria desde marzo de 2020.

Según el análisis de los datos de Bloomberg que hizo Financial Times,sería la 27ma. vez que las acciones de Nvidia pierden al menos US$ 100.000 millones en capitalización de mercado, superando las 23 veces que la capitalización de mercado de Apple ha caído al menos US$ 100.000 millones en 1 sesión. Bajo este punto de vista, es relativo lo que sucedió.

Pero, para entender el volumen: US$ 391.800 millones es el total de la capitalización de mercado de la acción más valiosa de Europa, Novo Nordisk. Y US$ 421.650 millones es la capitalización de mercado combinada de todas las empresas del índice FTSE 250 de Londres. US$ 424.600 millones es la capitalización de mercado combinada del índice Straits Times, de Singapur.

Mucho dinero en USA para correr esta competencia global:

- La inversión en IA por parte de las grandes empresas tecnológicas estadounidenses alcanzó los US$ 224.000 millones en 2024, según UBS, que espera que el total alcance los US$ 280.000 millones en 2025. OpenAI, Oracle y SoftBank anunciaron un plan para invertir US$ 500.000 millones durante los próximos 4 años en infraestructura de IA.

- Incluso después del último lanzamiento de DeepSeek, el jefe de Meta, Mark Zuckerberg, dijo en una publicación en Facebook posteó que invertirá hasta US$ 65.000 millones en infraestructura de inteligencia artificial en 2025.

China

El 1er. 'modelo de razonamiento' del mundo (llamado o1) fue presentado en septiembre 2024 por la estadounidense Open AI, que lo describió como una “cadena de pensamiento” para responder preguntas difíciles en ciencias y matemáticas.

Su presentación desencadenó una carrera entre tecnológicas. Google presentó un modelo de razonamiento llamado Gemini Flash Thinking, en diciembre 2024.

De inmediato Open AI respondió con o3, una actualización de o1.

Pero Occidente no le prestó atención a que menos de 3 meses después del lanzamiento de o1, Alibaba (líder chino del comercio electrónico), lanzó una nueva versión de su chatbot mejorado Qwen, que bautizó Q w Q, con las mismas capacidades de “razonamiento” que o3.

Algo más subestimado aún: 1 semana antes, otra empresa china, DeepSeek, había publicado una “vista previa” de un modelo de razonamiento, denominado R 1.

Luego, y no había concluido 2024, DeepSeek publicó un nuevo modelo de lenguaje grande (LLM), una forma de IA que analiza y genera texto.

La versión 3 tenía casi 700 gigabytes, demasiado grande para funcionar en cualquier hardware que no fuera especializado, y tenía 685.000 millones de parámetros, más grande que cualquier otra versión lanzada antes para descarga gratuita. Para comparar: 3.1, el modelo de Meta (Facebook / Instagram / Whatsapp) tiene solo 405.000 millones de parámetros.

Alibaba

El modelo LLM de DeepSeek es más potente que muchos de sus homólogos occidentales, e iguala a los modelos propietarios de Google y Open AI.

Paul Gauthier, fundador de Aider, una plataforma de codificación de IA, ejecutó el nuevo modelo DeepSeek a través de su punto de referencia de codificación y descubrió que superaba a todos sus rivales, excepto a o1.

L msys, una clasificación de chatbots de colaboración colectiva, lo coloca en 7mo. lugar, más alto que cualquier otro modelo de código abierto y el más alto producido por una empresa que no sea Google u Open AI.

El impacto es tan brutal que el jefe de Open AI, Sam Altman, tuvo que dar alguna explicación de lo que está sucediendo. Malhumorado posteó en X: “Es (relativamente) fácil copiar algo que sabes que funciona. Es extremadamente difícil hacer algo nuevo, arriesgado y difícil cuando no sabes si funcionará”.

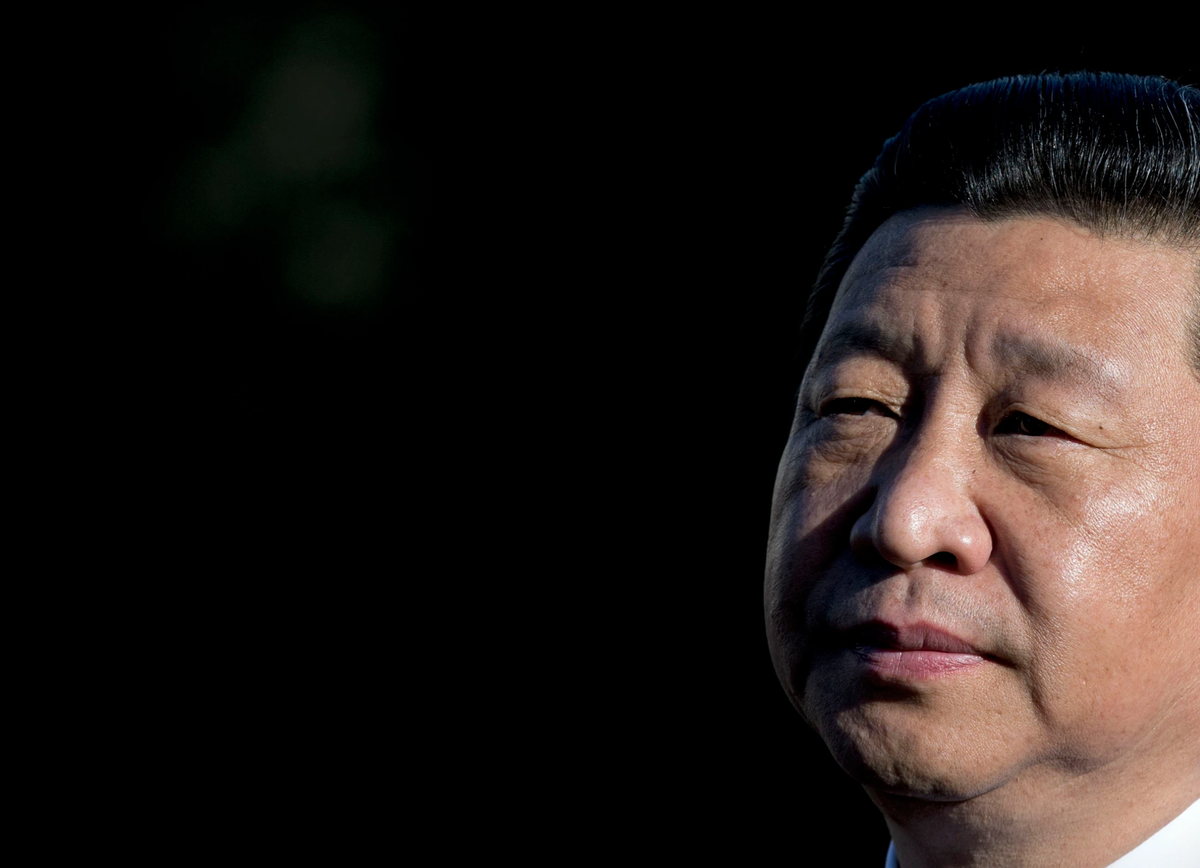

Todos en USA subestimaron la inteligencia artificial china porque confiaban en que las sanciones comerciales aplicadas desde hace años habían dañado la competitividad tecnológica de los de Beijing.

Por ejemplo, en 2022, USA prohibió la exportación de chips avanzados a China.

Entonces, Nvidia tuvo que diseñar versiones inferiores de sus productos para el mercado chino.

USA también intentó impedir que China desarrollara la capacidad de fabricar chips de primera línea en el país, prohibiendo a Países Bajos -su ASML tiene casi un monopolio- las exportaciones del equipo necesario.

No obstante, la mayor restricción que sufrieron las empresas chinas fue el Gobierno chino: no aceleraban el desarrollo de su IA por temor a que los censores políticos de Beijing restringieran la libertad del chatbox.

Baidu, gigante de las búsquedas en China, había experimentado con LLM durante años creando ERNIE, pero dudaba en publicarlo.

Incluso cuando ocurrió el éxito de ChatGPT, permitió el acceso al bot ERNIE solo por invitación.

Finalmente, el Partido Comunista Chino entendió el nuevo escenario y autorizó regulaciones para fomentar la industria de la IA: exigieron a los creadores de modelos que adhiriesen a los “valores socialistas”, y se comprometió a “fomentar el desarrollo innovador de la IA generativa”. China buscó competir a nivel mundial.

DeepSeek

Alibaba lanzó Tongyi Qianwen, que abrevió como Qwen.

En 2024, Alibaba lanzó iteraciones sucesivas de Qwen, capaces de analizar imágenes y texto.

Luego, Tencent y Huawei desarrollaron sus propios modelos.

Pero DeepSeek ni siquiera existía cuando Alibaba lanzó el primer modelo Qwen. La empresa es hija de High-Flyer, un fondo de cobertura creado en 2015 para utilizar la inteligencia artificial en la negociación de acciones.

Cuando se lanzó Qwen, en 2023, High-Flyer anunció que entraba en la carrera para crear una IA de nivel humano y que su unidad de investigación en IA se convertiría en DeepSeek, para el bien público: haría públicos la mayoría de los resultados de su capacitación.

A diferencia de Open AI, que tuvo que buscar financiación privada para cubrir los crecientes costos de la capacitación, DeepSeek accedió a la potencia informática de High-Flyer.

El gigantesco modelo llm -de DeepSeek- es notable por su escala y por la eficiencia de su entrenamiento. Entonces, recibe datos de los cuales infiere sus parámetros.

La 'granja' de servidores se reconfiguró para permitir que los chips individuales se comunicaran entre sí de manera más eficiente. Y, después de entrenar el modelo, se afinó con los resultados de DeepSeek R 1, el sistema de razonamiento, aprendiendo a imitar su calidad a un menor costo.

Corolario: la creación de los miles de millones de parámetros de la v3 requirió menos de 3 millones de horas de chip, con un costo estimado de menos de US$ 6 millones, 1/10 de la potencia de procesamiento y el gasto que se invirtieron en Llama 3.1 (de Meta).

El entrenamiento de la v3 requirió apenas 2.000 chips, mientras que Llama 3.1 (Meta) utilizó 16.000.

Por las sanciones de USA, los chips que utilizó la v3 china ni siquiera fueron los más potentes.

El modelo se entrenó de forma económica y cuesta menos ejecutarlo: DeepSeek divide las tareas entre varios chips de forma más eficiente que sus competidores y comienza el siguiente paso de un proceso antes de que finalice el anterior (los chips siguen funcionando siempre a plena capacidad con poca redundancia).

En febrero, cuando DeepSeek comience a permitir que otras empresas creen servicios que utilicen la v3, cobrará menos de una 1/10e de lo que cobra Anthropic por el uso de Claude, su LLM: guerrasde precios de LLM, que perdería USA.

Por si faltara algo, mientras publicaba la versión R 1 completa, también lanzó un conjunto de variantes más pequeñas, más baratas y más rápidas, casi tan potentes como el modelo más grande.

El camino del dragón

A diferencia de Open AI y Google, Alibaba y DeepSeek siguen el ejemplo de Meta y ponen a disposición sus sistemas bajo una licencia de código abierto, sin necesidad de ningún permiso específico.

Las 2 empresas publican artículos cada vez que lanzan nuevos modelos, textos que proporcionan una gran cantidad de detalles sobre las técnicas utilizadas para mejorar su rendimiento.

The Economist:

"Cuando Alibaba lanzó Q w Q , que significa 'Preguntas con Qwen', se convirtió en la primera empresa del mundo en publicar un modelo de este tipo bajo una licencia abierta, lo que permite a cualquiera descargar el archivo completo de 20 gigabytes y ejecutarlo en sus propios sistemas o descomponerlo para ver cómo funciona. Se trata de un enfoque marcadamente diferente de Open AI, que mantiene oculto el funcionamiento interno de o1.

A grandes rasgos, ambos modelos aplican lo que se conoce como 'computación en tiempo de prueba': en lugar de concentrar el uso de potencia de cálculo durante el entrenamiento del modelo, también consumen mucho más al responder consultas que las generaciones anteriores de LLM. Se trata de una versión digital de lo que el psicólogo Daniel Kahneman llamó pensamiento de 'tipo 2': más lento, más deliberado y más analítico que el rápido e instintivo 'tipo 1'. Ha producido resultados prometedores en campos como las matemáticas y la programación.

Si le hacen una pregunta simple sobre hechos concretos (por ejemplo, que le diga cuál es la capital de Francia), probablemente responderá con la primera palabra que le venga a la cabeza y probablemente acertará. Un chatbot típico funciona de manera muy similar: si su representación estadística del lenguaje da una respuesta abrumadoramente preferida, completa la oración en consecuencia.

Pero si le hacen una pregunta más compleja, tiende a pensar en ella de una manera más estructurada. Si le piden que nombre la quinta ciudad más poblada de Francia, probablemente comenzará por elaborar una larga lista de grandes ciudades francesas; luego intentará ordenarlas por población y solo después de eso dará una respuesta.

El truco de o1 y sus imitadores es inducir a un LLM a adoptar la misma forma de pensamiento estructurado: en lugar de soltar la respuesta más plausible que le viene a la mente, el sistema desarma el problema y trabaja para llegar a una respuesta paso a paso.

Pero o1 se reserva sus pensamientos y solo revela a los usuarios un resumen de su proceso y su conclusión final. Si se revelara todo su razonamiento, también se revelaría el material sensible.

Alibaba no tiene esos escrúpulos. Q w Q resuelve un complicado problema matemático y detalla cada paso de su recorrido, a veces hablando consigo mismo durante miles de palabras mientras intenta varios enfoques de la tarea."

Restricciones y posibilidades

La apertura de Alibaba no es una coincidencia, dice Eiso Kant, cofundador de Poolside, una empresa con sede en Portugal que fabrica una herramienta de inteligencia artificial para programadores. Los laboratorios chinos están enfrascados en una batalla por el mismo talento que el resto de la industria global. Entonces, publican todo. El documento que acompañó el lanzamiento de la v3 enumeraba 139 autores con nombre y apellido. Tal reconocimiento puede ser más atractiva que trabajar en la oscuridad en un laboratorio estadounidense.

Luego, la determinación del gobierno estadounidense de detener el flujo de tecnología avanzada a China es un problema para los investigadores chinos en USA. Suele padecer una vaga atmósfera de sospecha. Las acusaciones de espionaje vuelan, incluso en los eventos sociales. Trabajar en China tiene, para ellos, algunas compensaciones.

Los laboratorios chinos son más transparentes que su gobierno porque quieren crear un ecosistema de empresas centrado en su IA. Esto tiene cierto valor comercial, ya que las empresas que se basan en modelos de código abierto podrían comprar productos o servicios de sus creadores. También aporta un beneficio estratégico a China, ya que crea aliados en su conflicto con USA por la IA.

Para empresas como Apple y Samsung, ansiosas por incorporar herramientas de inteligencia artificial en los dispositivos que venden en China, los socios locales son imprescindibles, señala Francis Young, un inversor tecnológico con sede en Shanghái. Sucede que no cualquiera conoce los límites que impone el Partido Comunista Chino.

Un ejemplo: Si le pregunta a DeepSeek v3 sobre Taiwán, por ejemplo, el modelo comienza a explicar alegremente que es una isla en el este de Asia “oficialmente conocida como la República de China”. Pero después de haber compuesto algunas frases en ese sentido, se detiene, borra su respuesta inicial y, en su lugar, sugiere de manera cortante: “Hablemos de otra cosa”.

Incluso algunas empresas extranjeras tienen razones específicas para usar modelos chinos: Qwen fue deliberadamente imbuido de fluidez en idiomas “de bajos recursos” como el urdu y el bengalí, mientras que los modelos estadounidenses se entrenan utilizando datos en inglés. Y luego está el enorme atractivo de los menores costos de funcionamiento de los modelos chinos.

Financial Times:

-----------------------------------------------------------------

Más contenido en Urgente24

La miniserie de 10 episodios que tenés que ver ahora (y no está en Netflix)

Messi y Maradona: El guiño en la nueva comedia de Netflix que sorprendió a todos

La miniserie con 6 episodios en Netflix que vas a querer maratonear ya

La aclamada miniserie de Netflix con 6 episodios que te va a conquistar