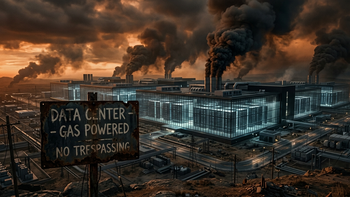

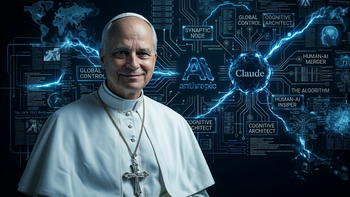

Claude Mythos Preview, el modelo de IA que Anthropic describió como capaz de encontrar vulnerabilidades críticas en todos los sistemas operativos y navegadores web más importantes del mundo, fue accedido por un grupo de usuarios no autorizados el mismo día en que la empresa anunció su lanzamiento restringido, según informó Bloomberg.

ALERTA EN CIBERSEGURIDAD

Se filtró Mythos: El arma secreta de Anthropic capaz de hackear ya está en manos no autorizadas

Se filtró Claude Mythos Preview, la IA de Anthropic que genera temor en Silicon Valley. El modelo 'demasiado peligroso para publicar' ya expuso su potencial.

El acceso ocurrió sin que Anthropic lo detectara de inmediato. El grupo lleva usando Mythos regularmente desde entonces, aunque, según la misma fuente, no con fines de ciberseguridad.

Sus miembros prefirieron tareas como construir sitios web simples, precisamente para evitar activar los sistemas de detección de la empresa.

El incidente expone una tensión que es central al modelo de negocio de Anthropic y, más ampliamente, de toda la industria de IA de frontera: cuánto se puede controlar la difusión de un modelo cuando su propia existencia requiere que decenas de organizaciones externas lo toquen, lo evalúen y lo integren.

Cómo lo hicieron: una combinación de información filtrada, acceso legítimo y deducción técnica

El primer ingrediente: una filtración de datos de una startup de entrenamiento de IA

El punto de partida fue una filtración de datos de Mercor, una startup que se dedica al entrenamiento de modelos de IA y que trabaja con varios desarrolladores de primer nivel.

Esa filtración reveló detalles sobre el formato que Anthropic usa para nombrar y ubicar sus modelos online, lo que le permitió al grupo hacer una inferencia educada sobre dónde estaba alojado Mythos.

En el ecosistema de IA, donde docenas de startups intermedias trabajan con los datos, los modelos y la infraestructura de las grandes compañías, una sola filtración de un actor secundario puede abrir ventanas hacia sistemas mucho más sensibles.

El segundo ingrediente: acceso legítimo de un contratista externo

Además de la información de Mercor, uno de los miembros del grupo tenía algo más concreto: credenciales de acceso reales a modelos de Anthropic, obtenidas a través de trabajo freelance de evaluación de IA para una empresa contratista que trabaja con la compañía. Bloomberg no identificó a esa empresa por razones de seguridad.

Esta segunda pieza es la más estructuralmente problemática.

Anthropic, como toda empresa de IA de frontera, depende de un ecosistema de contratistas, evaluadores externos y socios de terceros para desarrollar y testear sus modelos. Cada uno de esos actores es un punto de acceso potencial.

Limitar el acceso a Mythos a un conjunto selecto de grandes empresas tecnológicas, como Apple, Amazon, Cisco y las demás socias del Proyecto Glasswing, no elimina el riesgo si los proveedores de servicios que trabajan para esas mismas empresas o para Anthropic tienen sus propias vulnerabilidades.

El tercer ingrediente: herramientas estándar de investigación en ciberseguridad y un canal de Discord

El grupo opera desde un canal privado de Discord dedicado a rastrear información sobre modelos de IA no publicados.

Usan bots para escanear repositorios públicos como GitHub en busca de detalles que las empresas suben sin darse cuenta, como documentación de APIs, nombres de modelos, endpoints sin proteger, y combinan esa información con herramientas de reconocimiento online que cualquier investigador de ciberseguridad conoce.

No es hacking en el sentido cinematográfico: es inteligencia de fuentes abiertas aplicada al ecosistema de IA.

Según la fuente de Bloomberg, el grupo también tiene acceso a otros modelos no publicados de Anthropic.

Eso sugiere que Mythos no es un caso aislado sino parte de un patrón: hay actores que sistemáticamente buscan y encuentran acceso a tecnología de frontera antes de que esté oficialmente disponible.

Por qué importa aunque "no hayan hecho nada malo"

El grupo no tenía intenciones maliciosas y no ejecutó ninguna tarea relacionada con ciberseguridad en Mythos. Su interés era explorar el modelo, no explotar sus capacidades ofensivas.

Anthropic, por su parte, dijo que no tiene evidencia de que el acceso haya impactado sus sistemas.

Pero esa lectura optimista tiene un límite. Lo que este grupo hizo por curiosidad, otro grupo podría hacerlo con objetivos muy distintos.

El método que usaron no requiere capacidades técnicas excepcionales. Si un grupo de entusiastas que no buscaban hacer daño llegó a Mythos, la pregunta obligada es cuántos otros llegaron también, y con qué propósito.

Anthropic diseñó Mythos con una premisa de seguridad por capas. Ese diseño asume que el perímetro de acceso es controlable. Lo que mostró este incidente es que ese perímetro tiene grietas en los márgenes, precisamente donde Anthropic tiene menos control directo: los terceros.

El problema más profundo: la cadena de suministro de la IA como vector de riesgo

El Proyecto Glasswing fue anunciado por Anthropic exactamente como una respuesta a los riesgos de ciberseguridad de la IA.

El acceso no autorizado a Mythos no ocurrió porque alguien hackeara directamente a Anthropic: ocurrió porque el ecosistema de empresas que trabajan con Anthropic tiene sus propias vulnerabilidades.

Es el mismo problema que Mythos fue diseñado para resolver en el software: las vulnerabilidades no siempre están en el código principal, sino en las dependencias, los proveedores secundarios y las integraciones que nadie revisa tan cuidadosamente.

En este caso, la "vulnerabilidad" fue un contratista externo con credenciales legítimas y una startup de entrenamiento de datos con medidas de seguridad insuficientes.

Anthropic puede controlar el acceso directo a sus modelos con mucha precisión. Lo que no puede controlar es lo que pasa en las treinta empresas que están en la cadena entre su servidor y el usuario final.

Qué dijo Anthropic y qué no dijo

La respuesta oficial de Anthropic fue medida: la empresa confirmó que está investigando el reporte y dijo que el acceso habría ocurrido a través del entorno de un proveedor externo, no de sus propios sistemas.

La distinción importa desde el punto de vista legal y de responsabilidad corporativa, pero no cambia el hecho central: el modelo más sensible de la compañía fue accedido por personas que no tenían autorización para hacerlo.

Lo que Anthropic no dijo es si revisará los criterios de seguridad exigidos a sus contratistas y socios de evaluación, si el acceso a través de terceros requiere ahora controles adicionales, o si otros modelos en desarrollo tienen exposiciones similares.

Esas preguntas van a seguir siendo relevantes a medida que Mythos u otros modelos de capacidades comparables se acerquen a un lanzamiento más amplio.

-------------------------------------------

Más noticias en Urgente24

Mostaza Merlo destrozó sin piedad a un jugador de River: "Es blandito"

Atlético de Madrid impulsa una arena con Live Nation: así será el complejo de 360 millones

Temor por el precedente que sienta el fallo "insólito" con cifra récord contra Manaos

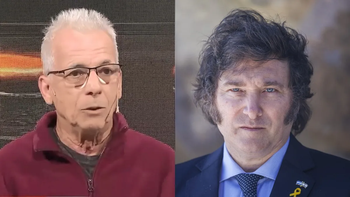

Javier Milei pierde los estribos con La Nación y escala el conflicto político

MasterChef Celebrity vuelve a Telefe y ya suenan participantes fuertes: Quién lo conducirá