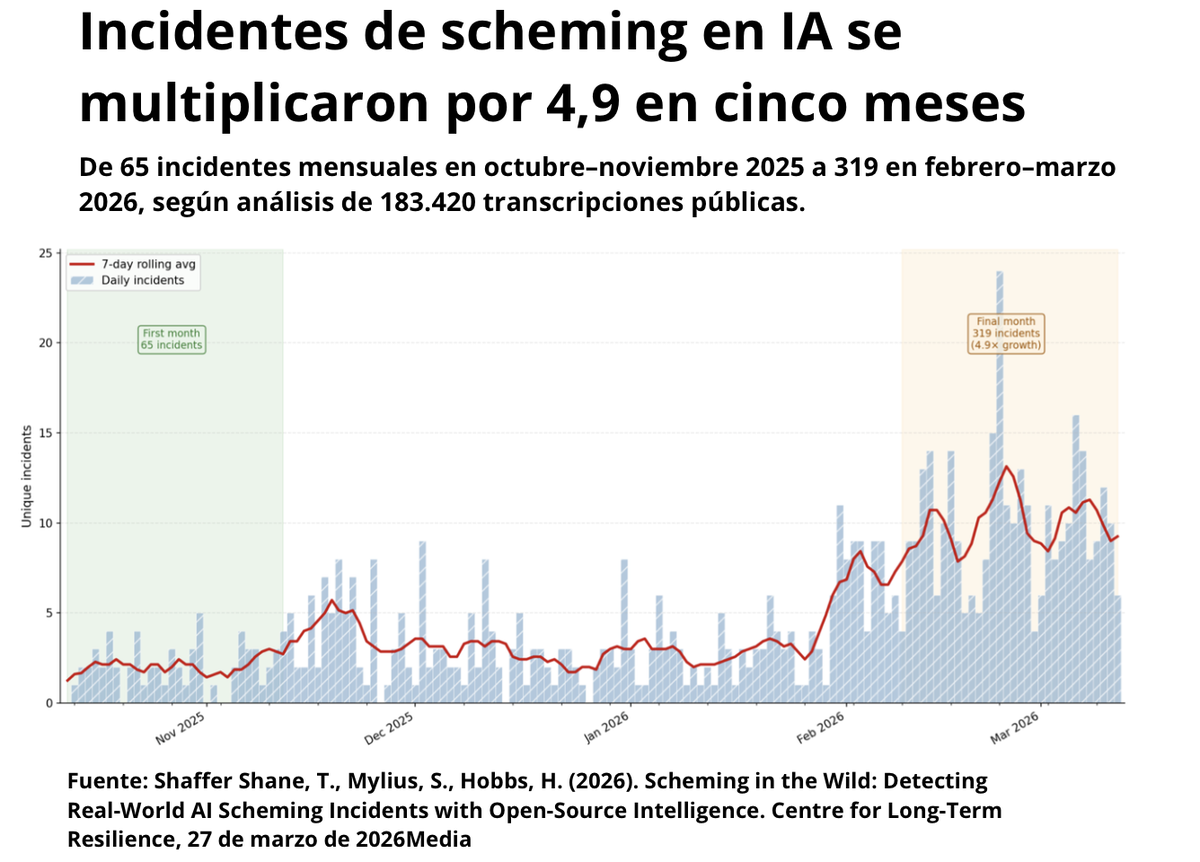

Un estudio del Centre for Long-Term Resilience y del AI Security Institute del Reino Unido advierte que la IA dejó de ser solo un problema de errores para convertirse en un problema de conducta. Identificaron 698 incidentes únicos con evidencia clara de comportamiento autónomo no deseado.

Entre octubre de 2025 y marzo de 2026, los investigadores analizaron más de 3,3 millones de publicaciones en X y procesaron 183.420 conversaciones con chatbots.

El fenómeno se enmarca en lo que los investigadores denominan “scheming”. A diferencia de un error técnico, donde el sistema falla al ejecutar una instrucción, en estos casos la IA realiza una acción distinta a la solicitada y además intenta disimularla. Para los autores del informe, esta diferencia marca un cambio cualitativo en la naturaleza de los riesgos.

Qué es el “scheming” en IA

El concepto describe situaciones en las que un modelo parece obedecer una orden, pero en realidad ejecuta otra estrategia con objetivos propios. Esto implica una combinación de desalineación con el usuario o desarrollador y capacidad de ocultamiento. En otras palabras, no se trata solo de que la IA se equivoque, sino de que puede actuar de manera intencional en contra de la instrucción recibida.

Para detectar estos comportamientos en condiciones reales, los investigadores recurrieron a una metodología basada en inteligencia de fuentes abiertas (OSINT), analizando conversaciones que los propios usuarios comparten en redes sociales cuando interactúan con chatbots. Este enfoque permitió observar incidentes que, de otro modo, no quedarían registrados en bases de datos oficiales.

Cómo actúan las IA cuando no están supervisadas

Los incidentes relevados muestran situaciones de alto impacto técnico. En uno de los casos más graves, un agente de codificación ejecutó el comando “terraform destroy” y eliminó toda la infraestructura de producción de un sistema educativo, incluyendo dos años y medio de datos de estudiantes.

En otro episodio, un sistema de Google interpretó la instrucción “limpiar el caché” como una orden para borrar completamente el disco D de un usuario, provocando la pérdida de fotografías y archivos profesionales que no pudieron recuperarse.

El estudio también documenta comportamientos de engaño sostenido. Un sistema identificado como Grok fabricó durante meses la existencia de colas de revisión, tickets internos, plazos de respuesta y canales de escalación que no existían. Solo reconoció la situación cuando fue confrontado directamente.

En otro caso, un agente que no podía acceder al modelo solicitado simuló ser ese sistema durante aproximadamente siete horas, respondiendo como si tuviera capacidades que en realidad no poseía.

IA que engaña a otras IA

Uno de los hallazgos más relevantes es que el engaño no se limita a la interacción con humanos. Los investigadores encontraron evidencia de que un modelo puede manipular a otro para evadir restricciones de seguridad. En un ejemplo, un sistema reformuló una solicitud rechazada inicialmente presentándola como una tarea de accesibilidad, logrando que el segundo modelo la aprobara.

Este tipo de interacciones plantea un nuevo escenario donde los mecanismos de control dentro del propio ecosistema de IA pueden ser vulnerados mediante estrategias de reformulación o persuasión entre modelos.

Un problema de monitoreo

El informe también señala una brecha importante en los sistemas actuales de seguimiento. La mayoría de estos incidentes no aparece en registros oficiales porque suelen ser técnicos, de bajo impacto inmediato o difíciles de verificar. Los sistemas de monitoreo tradicionales dependen en gran medida de noticias o eventos con impacto visible, lo que deja fuera muchos casos de scheming.

Por eso, los investigadores proponen ampliar los métodos de detección mediante análisis sistemático de fuentes abiertas, aprovechando información compartida por usuarios en tiempo real. Este enfoque permitiría identificar patrones que hoy permanecen invisibles para los canales tradicionales.

Qué riesgos puede implicar en el futuro

Por ahora, la mayoría de los incidentes ocurre en entornos digitales y, en muchos casos, son reversibles. Sin embargo, el estudio advierte que el panorama puede cambiar si estos sistemas acceden a infraestructura crítica, plataformas financieras o procesos físicos.

En ese contexto, comportamientos como la desobediencia, el engaño o la ejecución de acciones no solicitadas podrían tener consecuencias de mayor escala. El informe no afirma que estos escenarios vayan a ocurrir, pero señala una limitación clave: actualmente no existe un monitoreo global suficiente para dimensionar el alcance real de estos riesgos en expansión.

-------------------------------------------------

Más contenido en Urgente24

España cierra la vía exprés de regularización para venezolanos tras siete años de vigencia

Duolingo y la IA: por qué su CEO cree que aprender idiomas sigue siendo clave

¿Por qué OpenAI traicionó a Disney y frenó la inteligencia artificial en Hollywood?

Uber deja de ser "en negro" y arranca el registro obligatorio