La filtración de Claude Code expuso el funcionamiento interno de uno de los productos más importantes de Anthropic. El incidente, que ocurrió por un error humano, permitió acceder a más de 500.000 líneas de código y reveló cómo opera uno de los asistentes de programación más avanzados del mercado.

INTELIGENCIA ARTIFICIAL

Anthropic: Filtración de Claude Code deja al descubierto el "cerebro" de la IA

Un error humano dejó al descubierto el código fuente de Claude Code, asistente de programación de Anthropic. La filtración estuvo activa durante varias horas.

El caso no solo abre interrogantes sobre la seguridad en inteligencia artificial, sino que también deja en evidencia la arquitectura, estrategias y próximos desarrollos de la compañía en plena expansión.

¿Cómo ocurrió la filtración de Claude Code?

El problema se originó cuando Anthropic publicó por error un archivo interno de depuración dentro del paquete de Claude Code en npm. Se trataba de un archivo .map de casi 60 MB que contenía el código fuente completo en TypeScript.

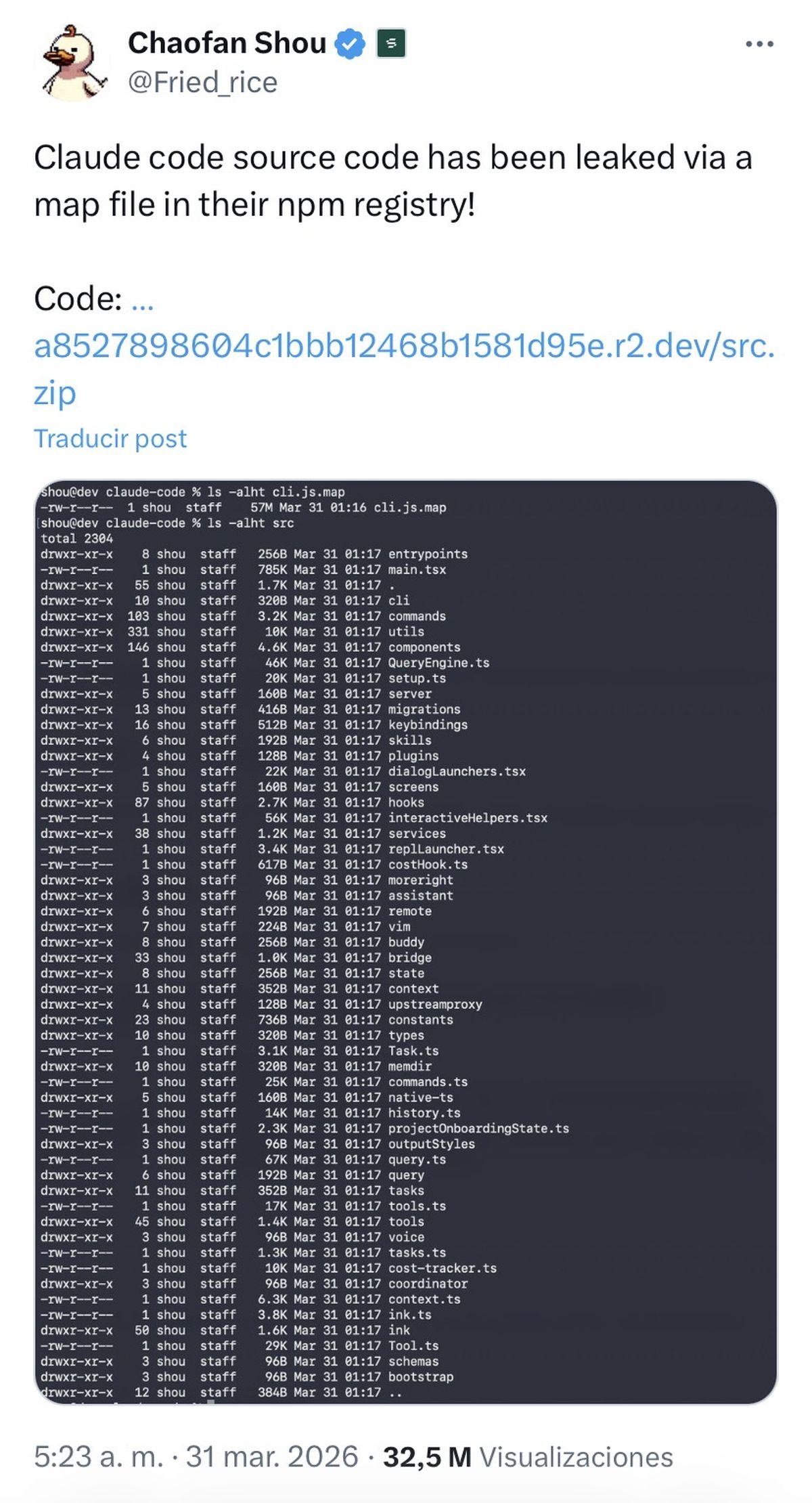

El hallazgo fue detectado por Chaofan Shou, un investigador que difundió el acceso a través de X. En cuestión de horas, el código fue replicado en GitHub y analizado por miles de desarrolladores.

Según un vocero de Anthropic, en una declaración enviada por mail a VentureBeat, el incidente se debió a un error en el empaquetado del lanzamiento y no a un ataque.

Un negocio millonario en riesgo

El impacto del incidente va más allá de lo técnico. Claude Code es uno de los productos más rentables de Anthropic, con ingresos recurrentes estimados en 2.500 millones de dólares anuales.

Además, el 80% de su adopción proviene de empresas, lo que convierte a esta herramienta en un activo clave dentro del mercado de inteligencia artificial. La filtración representa una fuga estratégica de propiedad intelectual: competidores ahora tienen acceso directo a cómo está construido un sistema de IA comercial de alto nivel.

Cómo funciona la “memoria” de la IA

Uno de los hallazgos más relevantes del código filtrado es el sistema de memoria del agente. En lugar de almacenar toda la información, Claude Code utiliza una arquitectura de tres capas más eficiente.

El núcleo es un archivo llamado MEMORY.md, que no guarda datos sino referencias. A partir de ahí, el sistema recupera información específica bajo demanda, evitando sobrecargar el contexto.

Este enfoque, denominado “Self-Healing Memory”, obliga al sistema a verificar la información antes de usarla, reduciendo errores y alucinaciones. Para los expertos, este modelo marca un cambio clave en el diseño de agentes de inteligencia artificial.

KAIROS: la IA que trabaja sola

La filtración también reveló una función llamada KAIROS, un modo que permite a Claude Code operar en segundo plano de forma autónoma.

A diferencia de los sistemas actuales, que reaccionan a comandos, este modo permite que la IA siga trabajando incluso cuando el usuario no está activo.

El sistema ejecuta procesos de “autoDream”, donde reorganiza información, elimina inconsistencias y mejora el contexto general. Esto hace que, al volver, el usuario encuentre una IA más precisa y actualizada.

Modelos en desarrollo y fallas detectadas

El código también expuso detalles sobre modelos en desarrollo dentro de Anthropic.

Entre ellos aparece Capybara, una evolución de Claude 4.6, que aún presenta problemas: versiones recientes muestran una tasa de errores del 29% al 30%, superior a iteraciones anteriores.

Estos datos son especialmente valiosos para la competencia, ya que permiten entender los límites actuales de la tecnología y sus desafíos.

“Modo encubierto” y uso en código abierto

Otro punto polémico es el llamado “Undercover Mode”. Esta función permite que la IA contribuya a proyectos de código abierto sin revelar que fue utilizada.

El sistema está diseñado para evitar cualquier referencia interna a la empresa, lo que deja preguntas sobre transparencia en el uso de inteligencia artificial en entornos públicos.

Impacto: una ventaja para la competencia

La filtración convierte a Claude Code en un “manual abierto” para otras empresas. Desde su arquitectura de memoria hasta sus sistemas de validación, todo puede ser analizado y replicado. Esto podría acelerar el desarrollo de herramientas similares sin necesidad de grandes inversiones en investigación.

En paralelo, también aumenta el riesgo de ataques, ya que actores maliciosos pueden estudiar cómo funcionan sus mecanismos de seguridad. En la era de la inteligencia artificial, no solo importa qué tan potente es un sistema, sino qué tan seguro es su desarrollo.

¿Querés estar al tanto de la próxima movida de Anthropic?

-------------------------------------------------

Más contenido en Urgente24

Ley de Glaciares: Sale a la luz dura carta de científicos internacionales

Cambian las transferencias para siempre: la modificación que impacta en Argentina

El video viral de Disney Japón que impacta en X: varios cuervos destrozan a Rapunzel

Como a los jubilados, Milei les dio un bono a las fuerzas de seguridad